特征

特征选择和提取目的都是为了在尽可能保留识别信息的前提下,降低特征空间的维数,以达到有效的分类。

特征选择

从度量值集合中按某一准则选取出供分类用的子集,作为降维的分类特征。

特征提取

使经过选择的特征通过某种变换,产生新的分类特征(或称为二次特征)。

特征提取会使特征的维度减少。

特征维数灾难

如果将数目很多的测量值不做分析,全部直接用作分类特征,不但耗时,而且会影响到分类的效果。被称为“特征维数灾难”问题。

模式类别可分性的测度

距离

一般考虑欧氏距离,即 ![]() 范数。

范数。

散度矩阵

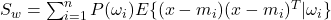

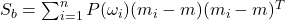

类内散度矩阵就是每个类别的样本都减去自己的样本均值,得到结果进行点乘,然后相加,最后得到一个维度 × 维度的矩阵。

类内散度矩阵和类间散度矩阵都是维度 × 维度的矩阵。

特征选择

- 穷举法:对每种选法都用训练样本试测出其正确分类率,然后做出性能最好的选择。需要进行

次选取。

次选取。 - 使用简便的可分性准则,间接判断每一种子集的优劣。

- 对于独立特征的选择准则

- 一般特征的散布矩阵准则

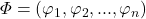

对于独立特征的选择准则

使不同类别模式特征的均值向量之间的距离最大,而属于同一类的模式特征的方差之和最小。

可分型准则函数

![]()

其中, ![]() 和

和 ![]() 分别为两类的均值向量和方差。

分别为两类的均值向量和方差。![]() 值越大,说明对应分量的有效性更强。应选取

值越大,说明对应分量的有效性更强。应选取 ![]() 值最大的数个特征。

值最大的数个特征。

假若类概率密度函数不是或不近似正态分布,均值和方差就不足以用来估计类别的可分性,此时该准则函数不完全适用。

一般特征的散布矩阵准则

- 类内散度矩阵:

- 类间散度矩阵:

类间离散度越大且类内离散度越小,则可分性越好。

离散K-L变换

K-L变换,全称Karhunen-Loeve变换(卡洛南-洛伊变换),是一种适用于任意概率密度函数的正交变换。

将原来的特征做正交变换,使获得的每个数据都是原来多个数据的线性组合,然后从新的数据中选出少数几个,使其尽可能多地反映各类模式之间的差异,且特征间又尽可能相互独立。

计算步骤

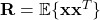

- 求出随机向量

的自相关矩阵

的自相关矩阵

- 求出矩阵

的特征值

的特征值  和对应的特征向量

和对应的特征向量  , 得矩阵

, 得矩阵

- 计算展开式系数

。

。

通过选择前若干个特征向量,可以在保留数据主要特征的同时,最小化变换误差。这样,特征间尽可能相互独立,且能反映各类模式之间的差异。

若采用较大特征值对应的特征向量组成变换矩阵,K-L变换也称为主成分变换(PCA变换)。

发表回复