机器学习

定义

机器学习更强调面向算法,而统计学更偏重于面向模型。

换而言之,机器学习强调算法的结果要好,所以机器学习很关注损失函数。而统计学要先扔出来一大堆模型假设,然后站在模型上面通过严格的数学推导做出结果。

统计机器学习

是基于数据构建概率统计模型并运用模型对数据进行预测分析的一门学科。

学习任务

- 经验(E): 训练数据

- 模型(T)—需要学习的目标函数

- 学习算法: 怎么样从经验中推断出模型

- 评价(P): 测试数据

框架

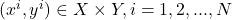

- 输入

- 独立同分布

的训练样本

的训练样本

- 对于回归,

是连续的;

是连续的; - 对于分类,

是类别;

是类别; - 对于排序,

是序数。

是序数。

- 对于回归,

- 独立同分布

- 目标函数

- 对于线性回归,

是线性的;

是线性的; - 对于广义线性回归,

是非线性的。

是非线性的。

- 对于线性回归,

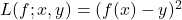

- 损失函数

- 对于回归,

- 最小化均方误差(MSE)的回归函数由条件分布

的

的  的均值给出。

的均值给出。

- 最小化均方误差(MSE)的回归函数由条件分布

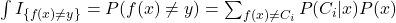

- 对于分类,

- 对于回归,

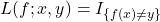

- 期望风险

- 对于回归,

- 对于分类,

- 对于回归,

风险最小化

期望风险最小化

![]()

经验风险最小化ERM

![]()

- 有过拟合风险。

结构风险最小化SRM

![]()

是惩罚参数,也称正则项,起到避免过拟合的作用。

是惩罚参数,也称正则项,起到避免过拟合的作用。

越大,说明正则项越重要,一般小的

越大,说明正则项越重要,一般小的  对应大的复杂度。

对应大的复杂度。

训练和测试

训练集和测试集一般是不同的,机器学习的目标是在测试集上取得好的成果。

过拟合:在训练集的效果太好了,没有泛化能力,于是在测试集上表现差。

范数

范数对应Lasso回归,拉向坐标轴,即尝试将某些坐标设置为0(特征选择)。

范数对应Lasso回归,拉向坐标轴,即尝试将某些坐标设置为0(特征选择)。 范数对应岭回归,直接拉向原点。

范数对应岭回归,直接拉向原点。

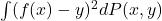

泛化能力

![]()

- Bias 度量了模型的期望预测和真实结果的偏离程度

- Variance 刻画了数据扰动所造成的影响

- Noise 刻画了问题的难易程度

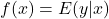

偏差-方差分解

- 用

表示在数据集

表示在数据集  上训练的预测函数。

上训练的预测函数。 - 用

表示最优函数,如回归问题中,

表示最优函数,如回归问题中, 。

。

![Rendered by QuickLaTeX.com \[<span class="ql-right-eqno"> </span><span class="ql-left-eqno"> </span><img src="http://www.be-a-quail.com/wp-content/ql-cache/quicklatex.com-1588fa72a0a3f7e1aea500fd0dea522d_l3.png" height="108" width="693" class="ql-img-displayed-equation quicklatex-auto-format" alt="\begin{align*} E((f_D(x) - f(x))^2) &= E(f_D(x)^2 - 2f_D(x)f(x) + f(x)^2) \\&= E(f_D(x)^2) - 2E(f_D(x)f(x)) + E(f(x)^2) \\&= D(f_D(x)) + E(f_D(x))^2 + D(f(x)) + E(f(x))^2 - 2E(f_D(x))E(f(x)) \\&= D(f_D(x)) + D(f(x)) + (E(f_D(x)) - E(f(x)))^2 \end{align*}" title="Rendered by QuickLaTeX.com"/>\]](http://www.be-a-quail.com/wp-content/ql-cache/quicklatex.com-f0c7b71ee94d51fff8c17f9662bdea62_l3.png)

模型复杂度

- 非常灵活的模型具有低偏差和高方差。

- 相对刚性的模型有大的偏差和低的方差。

- 具有最佳预测能力的模型是使得偏差和方差之间最佳平衡的模型。

泛化分析

泛化误差

![]()

训练误差

![]()

训练误差一般小于泛化误差。

本章为引入,无作业

发表回复